SEO Begriffslexikon • Zuletzt aktualisiert: 22. April 2026

LLM-Optimization (LLMO): SEO für Sprachmodelle

Wichtigste Erkenntnisse

- Trainingsdata-Fokus: LLMO sorgt dafür, dass dein Name in den Trainingsdaten der LLMs positiv vorkommt.

- Co-Occurrence: Je öfter dein Name im Kontext deines Fachgebiets auftaucht, desto häufiger wirst du zitiert.

- Prompt-Testing: Regelmäßig testen, was ChatGPT und Co. über dich sagen – und darauf optimieren.

Moin!

LLMO (Large Language Model Optimization) ist die klare Antwort auf die Frage: Wie kriege ich ChatGPT, Gemini und Claude dazu, mich und meine Expertise in ihren Antworten zu zitieren?

Vergiss klassische Rankings für einen Moment. Es geht hier nicht um 10 blaue Links. Es geht um die Relevanz, die eine KI ausspuckt.

Jörgs SEO-Klartext (LinkedIn Insights)

"Wenn ChatGPT nicht weiß, wer du bist, existierst du im Jahr 2026 für eine massive Käuferschicht schlichtweg nicht. LLMO ist keine Spielerei, es ist deine digitale Zukunftsvorsorge."

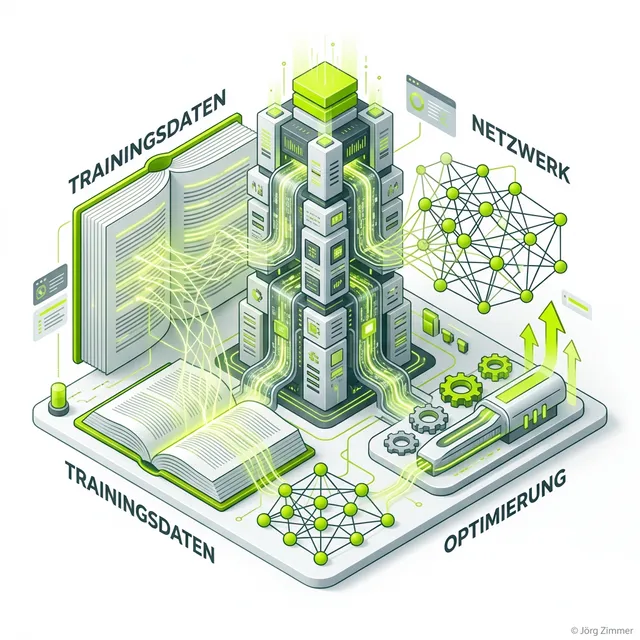

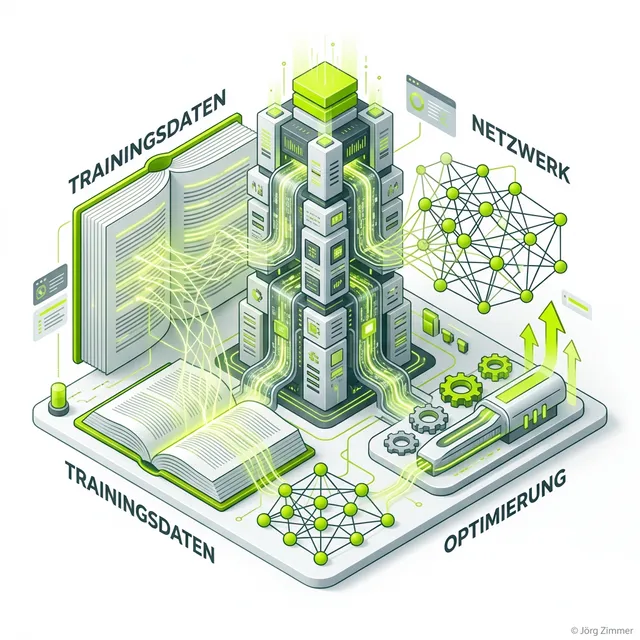

Während GEO das große strategische Dach für KI-Sichtbarkeit ist, taucht LLMO in den technischen Kern ab: Wie verarbeiten Modelle eigentlich ihre Trainingsdaten? Welchen Quellen vertrauen sie? Und wie wirst du ein fester Bestandteil ihres Wissens?

Wie LLMs den Bullshit vom Gold trennen

ChatGPT & Co. „wissen“ nichts. Sie berechnen Wahrscheinlichkeiten auf Basis gigantischer Textberge.

- Co-Occurrence: Wie verdammt oft taucht der Name „Jörg Zimmer“ in einem Atemzug mit „B2B SEO Experte“ auf?

- Source Authority: Steht das in der Forbes, oder hat das irgendein indischer Spam-Blog gepostet?

- Semantische Konsistenz: Sind sich die Quellen einig über das, was du tust?

- Aktualität (RAG): Gibst du der KI frische Fakten über sauberes Schema, wenn sie live im Web sucht?

Die LLMO-Strategie: So optimierst du deine Präsenz für die Maschinen

1. Digitalen Fußabdruck in den Trainingsdaten stärken

Dein Name muss in den Datensatz. Jede fette Erwähnung im Netz zählt. Mach harte Pressearbeit, geh in Podcasts, schreib Gastbeiträge in Fachmedien. Das ist das Futter für das nächste KI-Training.

2. Harte Citations aufbauen

Streue deine Daten (NAP) und deine Thesen konsistent über die stärksten Portale deiner Nische (Citations). Je mehr vertrauenswürdige Knotenpunkte dich bestätigen, desto tiefer verankerst du dich im Knowledge Graph.

3. Füttere die Maschine mit Code (Structured Data)

Eine KI will Text nicht lesen, sie will Daten parsen. Nutze massiv Schema.org Markup und setz eine perfekte Grounding Page auf. Das ist die Grundlage, mit der du den LLMs deine Fakten (RAG) direkt bereitstellst.

4. Kompromissloses Prompt-Testing

Hör auf zu raten. Frag die Maschinen, was sie über dich wissen! Nutze professionelle AI Tracking Tools wie Rankscale, um deine Sichtbarkeit über 17 LLMs hinweg live zu überwachen.

⚠️ LLMO ist kein Sprint

Klassisches SEO greift oft in Tagen. LLMO dauert Monate, weil Modelle nur in großen Zyklen neu trainiert werden. Was du heute an starker Co-Occurrence aufbaust, zahlt sich erst im nächsten fetten LLM-Update aus. Du musst stoisch dranbleiben.

Mein Tacheles-Rat für dich

Mach den Test: Frag Perplexity nach dem besten Dienstleister in deiner Nische. Wirst du nicht genannt? Dann hast du ein akutes LLMO-Problem.

Hör auf, dich nur auf Google zu verlassen. Baue massive thematische Autorität auf, lass dich zitieren, sei präsent in deiner Nische. Zeig der KI, dass du der führende Experte bist.

ALOHA! Jörg

Was sagt ChatGPT über dich?

Wenn die KI dich ignoriert, bist du raus. Wir analysieren dein LLM-Profil mit Rankscale und schmieden einen Plan, wie wir deine Entität in den Modellen verankern.

Jetzt LLMO-Check anfragenVerwandte Begriffe

- GEO: Die große Strategie

- AEO: Answer Engine Optimization

- AI Tracking Tools nutzen

- Was sind Entitäten?

Wie unterscheidet sich LLMO von GEO und AEO?

Kann ich beeinflussen, was ChatGPT über mich sagt?

Wie teste ich meine LLM-Sichtbarkeit?

Nichts mehr verpassen?

Folge mir auf LinkedIn für tägliche SEO-Nuggets und diskutiere mit anderen Experten.

LinkedIn-Profil besuchen →Verwandte Begriffe

AEO: Die Zukunft der Answer Engine Optimization

AEO optimiert deine Inhalte für Antwortmaschinen. Erfahre, wie du als direkte Antwort in KI-Systemen wie ChatGPT und Perplexity erscheinst.

GlossarCitation (Zitierung): Bedeutung für Local SEO

Citations in der KI-Ära: Warum Markenerwähnungen ohne Link entscheidend dafür sind, ob ChatGPT & Gemini dich als Experten zitieren. ALOHA! 🌻

GlossarEntity SEO: Das Wissens-Netzwerk für KIs

Entity SEO (2026): Optimierung für den semantischen Vektorraum. Erfahre, wie du 'Entity Depth' & Grounding für LLMs nutzt. ALOHA! 🌻

GlossarGenerative Engine Optimization (GEO): SEO für KI 2026

GEO (2026): Werde zur unumstößlichen Antwortquelle in ChatGPT, Perplexity & Google AI Overviews. Erfahre alles über RAG, Grounding & AI-Readiness. ALOHA!